AI换脸+拟声 “深度伪造”的迷局何时能解?

2025-03-23 06:09 央视新闻

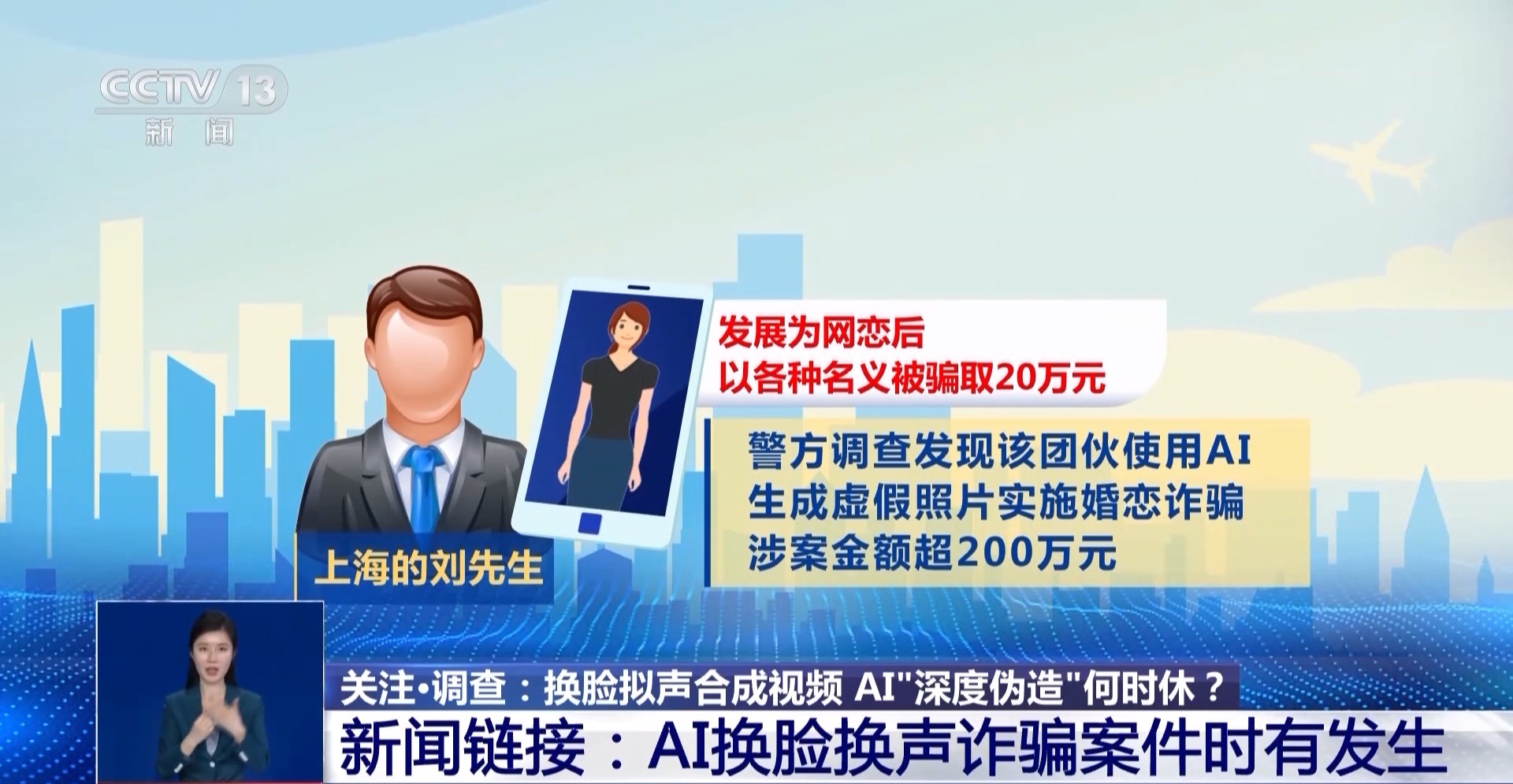

AI换脸换声诈骗案件时有发生

除了伪造名人形象带货营销,AI换脸和语音合成技术还被用于诈骗。犯罪分子通过非法获取的人脸照片和语音样本,利用开源AI工具生成逼真的虚拟形象。

此前内蒙古警方破获的一起AI换脸诈骗案中,福建某科技公司老板郭先生在视频通话中目睹“好友”面容,10分钟内被骗转账430万元,事后发现对方竟是AI换脸与拟声技术合成的“数字替身”。

在另外一起案件中,上海的刘先生在短视频平台结识“焦女士”,发展为网恋后以各种名义被骗取20万元,警方调查发现该团伙使用AI生成虚假照片实施婚恋诈骗,涉案金额超200万元。

AI换脸+拟声

记者体验“深度伪造”

人脸替换、声音模拟,网络上泛滥的AI“深度伪造”究竟是怎么做到的?真的很容易吗?记者找技术人员去做了个测试,将事先录制好的视频换成记者的脸和声音。仅通过记者的证件照片,不到两分钟,视频的人脸就换成了记者的脸。随后是声音的AI制作,记者现场录制了一段声音输入到AI资料库中。

网络技术人员 潘季明:我们收到您的录音片段之后,通过AI算法进行分析和学习,然后通过任意的输入文本,可用您的声音进行朗读。

AI制作的换脸和声音的视频完成后,将两段视频合成后,一段AI生成的记者视频就产生了。

AI合成声音制作视频

购物平台随意定制